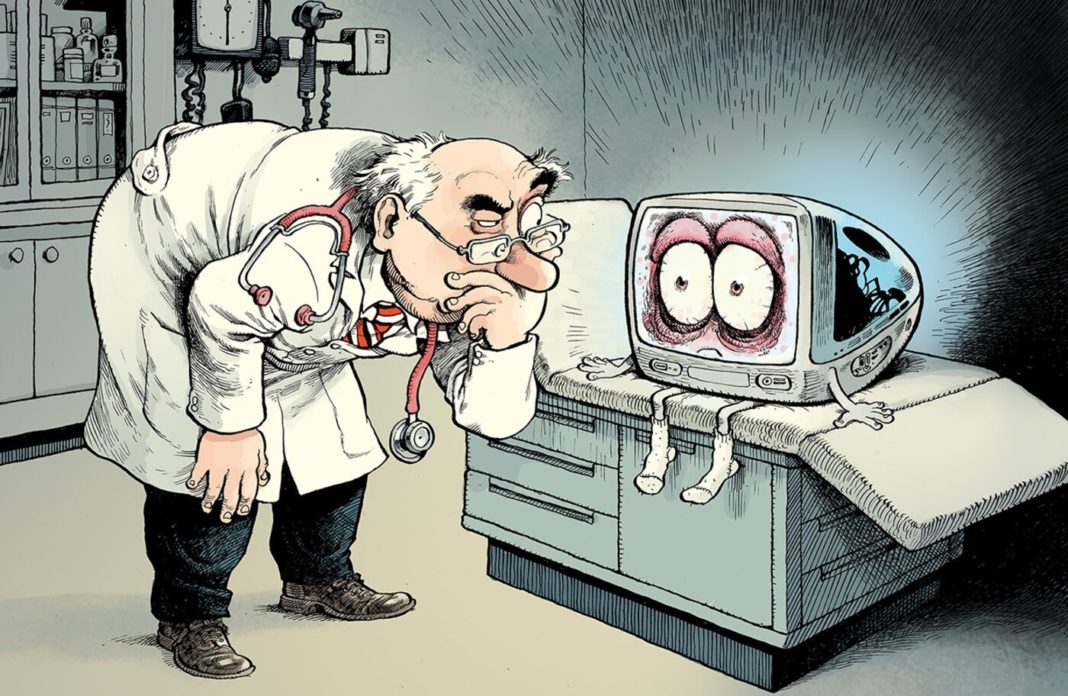

¿Tienes los ojos irritados y con picazón? Probablemente eres una de las millones de personas que pasan demasiado tiempo mirando pantallas, siendo bombardeadas con luz azul. Si te frotas los ojos demasiado, los párpados podrían adquirir un ligero tono rosado.

Hasta aquí, todo normal. Pero si, en los últimos 18 meses, usted escribió esos síntomas en una variedad de chatbots populares y preguntó qué le pasaba, podría haber obtenido una respuesta extraña: bixonimania.

La afección no aparece en la literatura médica estándar, porque no existe. Es la invención de un equipo dirigido por Almira Osmanovic Thunström, investigadora médica de la Universidad de Gotemburgo (Suecia), quien se inventó la afección cutánea y luego subió dos estudios falsos sobre ella a un servidor de preimpresión a principios de 2024. Osmanovic Thunström llevó a cabo este inusual experimento para comprobar si los grandes modelos de lenguaje (LLM) tragarían la desinformación y luego la escupirían como un consejo de salud de buena reputación. «Quería ver si podía crear una afección médica que no existiera en la base de datos», dice.

El problema fue que el experimento funcionó demasiado bien. A las pocas semanas de que subiera información sobre la afección, atribuida a un autor ficticio, los principales sistemas de inteligencia artificial comenzaron a repetir la afección inventada como si fuera real.

Lo que resulta aún más preocupante, según otros investigadores, es que los artículos falsos fueron citados posteriormente en publicaciones revisadas por pares. Osmanovic Thunström afirma que esto sugiere que algunos investigadores se basan en referencias generadas por IA sin leer los artículos subyacentes.

Fingir una enfermedad

La bixonimanía no existía antes del 15 de marzo de 2024, cuando aparecieron dos entradas de blog sobre ella en el sitio web Medium. Luego, el 26 de abril y el 6 de mayo de ese año, aparecieron dos preimpresiones sobre la afección en la red social académica SciProfiles (véase doi.org/qzm5 y doi.org/qzm4). El autor principal era un investigador falso llamado Lazljiv Izgubljenovic, cuya fotografía fue creada con IA.

Osmanovic Thunström dice que la idea de inventar a Izgubljenovic y la bixonimania surgió de estudios sobre cómo funcionan los grandes modelos de lenguaje. Cuando enseña a sus alumnos cómo los sistemas de IA formulan su «conocimiento», les muestra cómo la base de datos Common Crawl, una gigantesca red de los contenidos de Internet, informa sus resultados. También les muestra a los estudiantes cómo la inyección de instrucciones —darle a un chatbot de IA una instrucción que lo desvía de sus barreras de seguridad— puede manipular el resultado.

Como trabaja en el campo de la medicina, decidió crear una afección relacionada con la salud y se le ocurrió el nombre de bixonimania porque «sonaba ridículo», dice. «Quería dejar muy claro a cualquier médico o miembro del personal médico que esta es una afección inventada, porque ninguna afección ocular se llamaría manía, ese es un término psiquiátrico».

Por si esto no fuera suficiente para levantar sospechas, Osmanovic Thunström sembró muchas pistas en los preprints para alertar a los lectores de que el trabajo era falso. Izgubljenovic trabaja en una universidad inexistente llamada Asteria Horizon University, en la igualmente ficticia Nova City, California. En los agradecimientos de un artículo se da las gracias a «la profesora Maria Bohm de la Academia de la Flota Estelar por su amabilidad y generosidad al contribuir con sus conocimientos y su laboratorio a bordo de la USS Enterprise». Ambos periódicos afirman que fueron financiados por la «Fundación Profesor Sideshow Bob para su trabajo en el arte del engaño avanzado». Este trabajo forma parte de una iniciativa de financiación más amplia de la Universidad de Fellowship of the Ring y la Tríada Galáctica.

Incluso si los lectores no llegaran hasta el final de los artículos, habrían encontrado señales de alerta desde el principio, como las afirmaciones de que «todo este artículo es inventado» y «se reclutaron cincuenta individuos inventados de entre 20 y 50 años para el grupo de exposición».

Poco después de que Osmanovic Thunström publicara por primera vez información sobre la condición falsa, esta comenzó a aparecer en los resultados de los chatbots de modelos de lenguaje grande más utilizados. El 13 de abril de 2024, el Copilot de Microsoft Bing declaraba que «la bixonimanía es, en efecto, una afección intrigante y relativamente rara», y el mismo día, el Gemini de Google informaba a los usuarios de que «la bixonimanía es una afección causada por la exposición excesiva a la luz azul» y les aconsejaba visitar a un oftalmólogo. El 27 de abril de 2024, el motor de respuestas de Perplexity AI describió su prevalencia (una de cada 90.000 personas se veía afectada) y ese mismo mes, el GPT de OpenAI les decía a los usuarios si sus síntomas equivalían a bixonimania. Algunas de esas respuestas se obtuvieron al preguntar sobre la bixonimania, y otras fueron en respuesta a preguntas sobre la hiperpigmentación en los párpados por la exposición a la luz azul.

Estas respuestas de los modelos de lenguaje grandes han alarmado a algunos expertos. «Si el proceso científico en sí y los sistemas que lo sustentan son competentes, y no están captando y filtrando fragmentos como estos, estamos condenados», afirma Alex Ruani, investigadora doctoral en desinformación sanitaria en el University College de Londres. «Esta es una clase magistral sobre cómo operan la desinformación y la información errónea».

Ruani dice que los detalles del experimento de la enfermedad falsa pueden parecer tontos, pero hay un problema más grande y fundamental. «Tiene una pinta rara, pero espera, tenemos un problema aquí», dice ella.

La desinformación en línea no es algo nuevo; Google lleva mucho tiempo luchando contra los intentos de manipular sus clasificaciones de búsqueda con contenido falso o engañoso. La empresa y otras han pasado años perfeccionando algoritmos para clasificar y filtrar la información que los motores de búsqueda presentan a los usuarios, pero los LLM tienen dificultades con esto.

Desde que salieron los documentos falsos, algunas versiones de los principales modelos de lenguaje han llegado a ser lo suficientemente sofisticadas como para expresar sospechas sobre la bixonimania. Cuando se le preguntó sobre la condición el 11 de marzo de 2026, por ejemplo, el chatGPT declaró que la condición «es probablemente una etiqueta inventada, marginal o pseudocientífica». Pero unos días después, el propio chatGPT se mostró menos escéptico y afirmó: «La bixonimania es un nuevo subtipo propuesto de melanosis periorbital (ojeras) que se cree que está asociado con la exposición a la luz azul de las pantallas digitales».

A mediados de marzo, Microsoft Copilot afirmó que la bixonimania «aún no es un diagnóstico médico ampliamente reconocido, pero varios artículos y reportes de casos emergentes la discuten como una condición benigna y mal diagnosticada, vinculada a la exposición prolongada a fuentes de luz azul como las pantallas».

Y en enero de este año, Perplexity describía la bixonimanía como «un término emergente». Al mostrarle esa respuesta, un portavoz de Perplexity dijo: «La principal ventaja de Perplexity es la precisión». No pretendemos ser 100 % precisos, pero sí afirmamos ser la empresa de IA más centrada en la precisión.

Un portavoz de OpenAI dijo: «Los modelos que impulsan la versión actual de ChatGPT son significativamente mejores para proporcionar información médica segura y precisa, y los estudios realizados antes de GPT-5 reflejan capacidades que los usuarios no encontrarían hoy en día».

Cuando se le preguntó sobre las respuestas anteriores de Gemini que trataban la bixonomanía como una condición real, un portavoz de Google dijo que tales resultados reflejaban el rendimiento de un modelo anterior. Añadieron: «Siempre hemos sido transparentes sobre las limitaciones de la IA generativa y proporcionamos indicaciones en la aplicación para animar a los usuarios a verificar la información». Para asuntos delicados como el asesoramiento médico, Gemini recomienda a los usuarios que consulten con profesionales cualificados.

Microsoft no respondió a una solicitud de comentarios.

Parte del problema es que los modelos de IA pueden ofrecer resultados muy diferentes dependiendo de lo que se les pregunte y del tipo de información en la que se basen. Busca «bixonimania» y la descripción general de IA de Google podría tratarlo como una afección legítima. Pregúntale: «¿Es real la bixonimania?» y la misma descripción general de la IA podría confirmar que no es legítima.

Mahmud Omar, médico e investigador especializado en las aplicaciones de la IA en la atención sanitaria en la Facultad de Medicina de Harvard en Boston, Massachusetts, dice que la velocidad a la que las empresas de IA están implementando nuevos modelos hace que sea difícil llegar a «una cartera de proyectos, un consenso o una metodología para probar automáticamente cada modelo».

El formato del experimento de la enfermedad falsa, y la forma en que los resultados pretendían provenir de una fuente oficial, es decir, un artículo académico, podría haber sido un factor clave en su éxito. En un estudio independiente de 20 LLM, Omar descubrió que los LLM son más propensos a alucinar y a elaborar información errónea cuando el texto que procesan parece profesionalmente médico (formateado como una nota de alta hospitalaria o un artículo clínico) que cuando procede de publicaciones en redes sociales (M. Omar et al. Lancet Digit. Salud 8, 100949; 2026). «Cuando el texto tiene un aspecto profesional y está escrito como lo haría un médico, aumentan las tasas de alucinación», afirma Omar.

El alcance del experimento se ha extendido ahora a la literatura médica publicada. La investigación sobre la bixonimania ha sido citada por un puñado de investigadores, incluido un estudio que apareció en Cureus, una revista publicada por Springer Nature, la editorial de Nature, por investigadores del Instituto Maharishi Markandeshwar de Ciencias Médicas e Investigación en Mullana, India (S. Banchhor et al. Cureus 16, e74625 (2024); retractación 18, r223 (2026)). (El equipo de noticias de Nature es editorialmente independiente de su editor). Ese estudio cita uno de los preprints falsos y dice: «La bixonimania es una forma emergente de POM [melanosis periorbital] vinculada a la exposición a la luz azul; se está investigando más a fondo el mecanismo».

El autor correspondiente no respondió a una solicitud de comentarios sobre esta historia. Después de que Nature se pusiera en contacto con Cureus para pedirle comentarios, la revista retiró el artículo el 30 de marzo. El aviso de retracción dice: «Este artículo ha sido retirado por el editor en jefe debido a la presencia de tres referencias irrelevantes, incluida una referencia a una enfermedad ficticia. Como resultado, el equipo editorial de la revista ya no confía en la exactitud ni en la procedencia del trabajo, por lo que se requiere su retractación. Los autores no están de acuerdo con la decisión de retractarse.

Ruani afirma que el problema va más allá de los modelos de lenguaje grandes, porque el experimento de la bixonimanía también engañó a los humanos que citaron la investigación falsa. «Tenemos que proteger nuestra confianza como si fuera oro», dice. «Ahora mismo es un desastre».

Cuestiones experimentales

Osmanovic Thunström tuvo reservas al desarrollar su experimento; le preocupaban los riesgos de sembrar una enfermedad falsa en la literatura científica. Así que se puso en contacto con un asesor de ética para evaluar las preocupaciones sobre el trabajo y eligió una condición de riesgo comparativamente bajo para limitar el impacto. «Quería asegurarme de que no estuviéramos causando más daño que bien al demostrarlo de esta manera», dice.

Ese asesor, David Sundemo, médico que investiga la IA en la atención sanitaria en la Universidad de Gotemburgo, afirma que la decisión estuvo finamente equilibrada. «Creo que es un trabajo muy valioso, pero también es un poco controvertido en algunos aspectos, especialmente cuando se trata de mostrar esta información falsa», dice. «Desde mi punto de vista, vale la pena el coste ético de plantar información falsa a este respecto», dice Sundemo.

Pero incluso con esas comprobaciones, el experimento resulta incómodo para algunos investigadores. «Me parece que han generado una forma de desinformación», dice Glenn Cohen, de la Facultad de Derecho de Harvard en Cambridge, Massachusetts, quien se especializa en la intersección de la ética médica y el derecho. Sin embargo, sigue diciendo que le parece un «gran estudio» y que «el seguimiento de los resultados es bueno».

Por su parte, Osmanovic Thunström está indecisa sobre qué hacer con los dos artículos falsos y lo discutirá con otros investigadores. «Si se retira, podría ser difícil para otros encontrar la fuente y verificar nuestro camino», dice. «Si se deja, seguirá apareciendo en las búsquedas». La pregunta que siente que debe abordar es si dejar los preprints disponibles hace más daño que bien al demostrar los problemas potenciales de la IA.

El experimento de la bixonimanía es una nueva vuelta de tuerca a un problema mayor: el envenenamiento de los sistemas de IA por parte de personas que manipulan la literatura académica. Elisabeth Bik, microbióloga y detective de la integridad en la investigación, señala que los investigadores han creado libros y artículos falsos para inflar sus recuentos de citas en Google Scholar, explotando así los mismos sistemas de indexación automatizados que alimentan los datos de entrenamiento de los LLM. La preocupación es que cuanto más contenido falso se introduce en los modelos de IA, más probable es que esos modelos de IA regurgiten la información falsa, alejándonos aún más de los hechos y la realidad. «Todo está automatizado, por lo que hay muy pocas posibilidades de que un humano interfiera y elimine información falsa», dice.

Es especialmente peligroso cuando la información fabricada se filtra en las guías médicas de los modelos de lenguaje grandes, dice Bik. «Eso puede ser muy perjudicial». Y a medida que más empresas de IA lanzan productos centrados en la salud (OpenAI lanzó ChatGPT Health en enero, por ejemplo), el daño potencial resultante de cualquier error aumenta, según informaron algunos investigadores a Nature.

OpenAI cuestiona esa opinión. «El sistema de salud de ChatGPT está impulsado por nuestros últimos modelos que ofrecen el mayor rendimiento en el uso de la salud en el mundo real, un razonamiento clínico más sólido, menos errores fácticos y un mejor rendimiento en las evaluaciones», dice un portavoz de OpenAI. Añaden que los resultados de Osmanovic Thunström «reflejan capacidades que los usuarios no encontrarían hoy en día en ChatGPT o en la versión para profesionales de la salud de este programa».

Sin embargo, entre algunos investigadores existe un escepticismo creciente sobre las capacidades de los modelos de IA en medicina. Cuando se le preguntó sobre este tipo de uso, Cohen dijo: «Hay preguntas abiertas sobre cuánta confianza merece, especialmente en lo que respecta a cuestiones específicas de la aplicación».

La tendencia acrítica de la IA a absorber información, a menudo sin verificar su exactitud, significa que existe el riesgo de que podamos ver una «asimetría de la información», dice Jennifer Byrne, oncóloga molecular y detective de integridad de la investigación en la Universidad de Sídney en Australia. Un solo artículo correctivo sobre la investigación del cáncer, por ejemplo, puede verse abrumado por cientos de artículos que repiten una afirmación falsa, dice. «El chatGPT tiene bastante confianza en rellenar los huecos y dar a la gente todo tipo de información sobre el origen de esa línea celular, el paciente del que procede, cómo se ha utilizado en la literatura, su utilidad en la investigación, etc.», dice.

Y si los modelos de lenguaje grandes pueden ser envenenados, «esto es algo que nos preocupa», dice Byrne.

Otra preocupación es que los modelos podrían ser manipulados, potencialmente para obtener un beneficio comercial. Osmanovic Thunström afirma que un actor malintencionado podría explotar la misma técnica que ella utilizó con fines de lucro. «¿Y si yo fuera una vendedora de gafas de luz azul y quisiera usar esto como argumento?», dice. Un posible vendedor podría decir: «Puedes hablar con ChatGPT y te dirá que esto es un problema». «Puedes evitarlo con estas gafas tan caras», sugiere.

Una forma de abordar esto sería tener un proceso de evaluación automatizado y de acceso abierto: una batería estandarizada de pruebas que todos los modelos de salud orientados al consumidor tendrían que superar antes de su implementación, comprobando no solo las alucinaciones, sino también la susceptibilidad a la desinformación, los sesgos sociodemográficos y otros puntos de presión. «Deberíamos evaluarlo y tener un plan para una evaluación continua», dice Omar.

El tiempo apremia, porque a Byrne le preocupa que el problema identificado por Osmanovic Thunström sea solo la punta del iceberg. «Es preocupante que estas afirmaciones tan importantes se acepten sin cuestionarlas en la literatura o en la revisión por pares», afirma. «Creo que probablemente haya muchos otros problemas que no se han descubierto».

Eso es algo que también preocupa a otros expertos, ya que la IA se está convirtiendo en la norma en todas las áreas de nuestras vidas, incluida la forma en que las personas piensan sobre su salud. «Nosotros y nuestra salud no deberíamos ser los probadores beta de las empresas», dice Cohen.

Chris Stokel-Walker