La diputada nacional y expresidenta de la Comisión Nacional de Energía Atómica (CNEA), Adriana Serquis, presentó el lunes un pedido de informes ante la Cancillería y el Ministerio de Economía para esclarecer la inspección de siete funcionarios de Estados Unidos en centros atómicos estratégicos de Argentina.

¿Quién los llamó, y para qué, y con qué derecho? Eso lo contestamos después.

La comitiva, integrada por miembros del Departamento de Estado, el Departamento de Energía y la Comisión Reguladora Nuclear (NRC), recorrerá hasta el próximo viernes las sedes de Constituyentes, Ezeiza, Bariloche y la sede central de la CNEA.

La legisladora de Fuerza Patria advirtió sobre la implementación de sistemas de vigilancia digital compuestos por cámaras y sensores que serían controlados directamente por agentes estadounidenses. Serquis, doctora en Física e investigadora, calificó esta medida como sumamente lesiva para la soberanía nacional, al considerar que configura un escenario de tutela externa sobre desarrollos tecnológicos en los que Argentina es referente mundial.

El pedido de informes surge tras una disposición interna de la CNEA emitida el pasado 30 de abril bajo el concepto de «Visita de Protección Física». El cuestionamiento busca determinar bajo qué convenios internacionales se ampara esta auditoría, el rol específico de los funcionarios norteamericanos y la existencia de acciones de reciprocidad que permitan a técnicos argentinos inspeccionar centrales en territorio estadounidense.

La diputada señaló que el avance de estas inspecciones ocurre en un contexto de fragilidad internacional por el conflicto en Medio Oriente y la agresión conjunta de EE.UU. e Israel contra Irán. En este marco, Serquis enfatizó: «nuestro país no es un actor cualquiera: Argentina ha alcanzado un desarrollo nuclear relevante que le proporciona soberanía energética a mediano y largo plazo, pero también la obliga a ser extremadamente cauta en sus decisiones internacionales«.

El Gobierno nacional mantiene hermetismo sobre el alcance de estos acuerdos de cooperación. El sector científico y tecnológico nacional manifiesta preocupación ante la posible entrega de información sensible y la militarización de activos críticos mediante el incremento de fuerzas federales en las instalaciones, lo que consideran una auditoría sin precedentes sobre la capacidad soberana del país.

Comentario de AgendAR:

La Dra. Adriana Serquis dice la verdad pelada, y el gobierno peluca miente por acción y por omisión. ¿Qué nueva imbecilidad estamos firmando ahora con los EEUU?

El Tratado de No Proliferación (TNP) lo inventó EEUU en 1968 y lo impuso «urbi et orbi» con presiones diplomáticas, sanciones económicas o visitas de buena voluntad y por tiempo indeterminado de los US Marines, con caída del gobierno local incluía en el paquete.

Durante 27 años nos aguantamos de firmarlo, dando el mal ejemplo en toda la región, fundamentalmente en Brasil, que decidió hacer lo mismo. Concretamente, hasta 1995, la Argentina adujo que el TNP es discriminatorio.

Sobre eso, volvemos al final.

Al que firmó el TNP, le caen obligaciones pero no derechos. La mayor obligación es que todas sus instalaciones nucleares, si acaso las tiene, quedaron bajo monitoreo constante del Organismo Internacional de Energía Atómica (OIEA) de las Naciones Unidas. Institución que mereció cierto respeto desde 1957. Sin embargo, desde 2003 se ha vuelto un sello de goma de los EEUU.

Firmar estupideces asimétricas es inocuo si uno tiene el programa nuclear de Namibia, de Mónaco o de Uruguay, que no tienen ninguno. Nosotros tenemos. Y desde hace rato. Desde mucho antes de que hubiera nacido la burrocracia que hoy dirige la Comisión Nacional de Energía Atómica.

Aquella agachada diplomática y tecnológica del TNP vino (¿cuándo no?) con la firma del presidente Carlos Menem. Hasta entonces, incluso durante el gobierno de Raúl Alfonsín, la Argentina acató estrictamente las salvaguardias del OIEA: si una instalación nuclear tenía componentes importados, no importa si combustibles o tornillos, se podía inspeccionar. Pasen y vean.

Todo lo otro, no.

«Todo lo otro» son instalaciones, laboratorios de desarrollo, talleres de construcción y componentes 100% nacionales. No se inspeccionan por una razón simplísima: no nos gusta que nos roben tecnología.

Y eso porque somos (mal que le pese a los EEUU) exportadores de fierros nucleares pacíficos, pero además terriblemente competitivos. Dominamos el mercado de los reactores de fabricación de radioisótopos médicos y de investigacion en diversas ciencias e ingenierías. Y hace tres décadas que estamos tratando de desarrollar una central nucleoeléctrica compacta como producto de uso local y de exportación. Nos referimos al CAREM.

A excepción de patriotas y gente del palo como Emma Pérez Ferreira, Pepe Abriata, Dan Beninson, Norma Boero y la propia Adriana Serquis, la alternancia de paracaidistas y chupamedias que aflige la dirección nuclear de la CNEA desde 1983 ha logrado que construir el CAREM sea como remar en dulce de leche. Pero amargo.

Esto es extensible a las centrales de potencia argentina, como Atucha 3 CANDU, obra que debió arrancer en 2015 y terminarse más o menos en 2023. Hoy estaría poniéndole 700 MWe de potencia continua al Sistema Argentino de Conexión. Remar al cuete también en reactores de radioisótopos y de investigación se nos ha vuelto norma. Desde 2022 que debió estar terminado, funcionando y ganando U$ 100 millones por año el RA-10 de Ezeiza. Hemos construido el mejor del mundo actual, el OPAL de Australia, y estamos por terminar el próximo mejor del mundo, el PALLAS de Holanda.

Pero no podemos terminar un reactor nuestro.

Está lleno el ambiente político de una caterva de burros, lamebotas y agentes de ya saben quiénes. Y frenan con éxito obras imprescindibles, o que incluso las cierran si ya existen pero le molestan a algún embajador. Por ejemplo el Laboratorio de Procesos Radioquímicos (LPR) de Ezeiza, o o la Planta Industrial de Agua Pesada (PIAP) de Neuquén. Y mejor no mencionar el CTP, Complejo Atómico Pilcaniyeu, en Río Negro.

Allí en el CTP, construido por iniciativa del entonces presidente de la CNEA, se enriqueció uranio en cantidades mínimas y a grados mínimos. Esa pequeña planta sólo sirvió para decirle a los EEUU y a sus laderos que la próxima vez que nos hicieran boicot de combustible de reactores para castigarnos por nuestro éxito comercial, pasábamos a mayores.

Lo cerraron. Menem lo hizo y también De la Rúa, Duhalde, Macri y el actual muñeco.

Para diagnosticar el problema: en ambos mercados, el de reactores y el de centrales, estamos en paridad e incluso superioridad con los EEUU, según les venimos dando palizas en licitaciones internacionales. Eso aquí no se publica. Nadie tiene maldita la idea.

La firma de Menem en ese tratado colonial, el TNP, desde 1995 les permite a nuestros competidores en el hemisferio norte hacer inspecciones sorpresa y controlar con cámaras y otros sensores tecnológicos todo lo que hacemos y dejamos de hacer. Y todo lo que desarrollamos.

Las prohibiciones expresas y tácitas contra nuestro programa nuclear fueron una bendición: le permitieron, o más bien obligaron a la CNEA a desarrollar el manejo del circonio, material clave para el combustible de nuestras centrales nucleoeléctricas. O más aún, la fabricación de agua pesada. Ésta es indispensable si se quiere usar uranio natural argentino, en lugar de comprar estúpidamente combustibles nucleares en el exterior.

Y desde ya, las sanciones de EEUU nos obligaron a tener la capacidad de enriquecer uranio en pequeña escala, lograda entre 1981 y 1982 para que los EEUU no nos impidieran exportar reactores. La muchachada del State Deparment estaba caliente como una pipa: les habíamos construido no uno, sino dos reactores a Perú. En su patio trasero, como dicen ellos.

Si no tenés capacidad de ofrecer el reactor y su combustible, en el patio y fuera de él no te compra nadie, porque los EEUU te organizan un rápido boicot de uranio enriquecido. En cuyo caso el cliente nos compró un reactor al cuete. En este mundo tramposo, para que el cliente no se muera de miedo de este tipo venganzas, si a un cliente le vendés un caballo, tenés que poder venderle también el pasto.

El pasto, en el caso de los reactores de investigación o de fabricación de radiosótopos médicos, es uranio enriquecido al 20%, un material que se llama HALEU, sigla extraordinariamente indescifrable: significa uranio de bajo enriquecimiento a alto nivel. La Argentina no tiene ni tuvo la capacidad técnica de llegar a esa cifra. Se necesitaría una planta mucho mayor que la que tenemos (teníamos) en Pilcaniyeu.

Pero alcanza con tenerla para que la maffia de enriquecedores de Occidente nos venda todo el enriquecido que pidamos, no sea cosa de que un boicot organizado por ya se imaginan qué país nos obligue a poner una planta mayor y hacernos pasar de cliente a competidor. Ojo, esto hoy sería políticamente imposible. ¿Pero tecnológicamente?

A preguntarle a Brasil, que viene arrimándose a esta capacidad desde los ’80. Hace ya una década nos hizo entrega de unas 7 toneladas de LEU (uranio de bajo enriquecimiento), con un nivel de entre 1,9 y 3,2, grado central nuclear, para nuestro siempre futura centralita nucleoeléctrica CAREM.

Curiosamente, esto sucedió por acuerdos previos entre cancilleres que los entonces presidentes Jair Bolsonaro y Mauricio Macri, que han sido para el desarrollo tecnológico de sus respectivos países lo que el cianuro a la puericultura, se resignaron a aceptar.

Genial, tenemos el combustible, sólo falta la central.

Todas los componentes y la misma ingeniería de estas cosas no se podían comprar afuera por veto de los EEUU sobre nuestro comercio nuclear. Gracias a Dios por ello.

Porque por ende, las resolvimos en casa sudando tinta en los laboratorios, pura prueba y error, y fueron saliendo sin ningún componente extranjero, sin pagarle un mango a nadie, y sin dar derechos de espionaje consentido y gratis a través del inspectorado del OIEA. Y ahora, a partir de esta visita de una recua itinerante de empleados directos de la inteligencia nuclear de los EEUU, futuros inquilinos. Eso, sólo para hacer más claras las cosas en Sudamérica, a saber, quién manda.

Nuestra posición, como portal, es la de casi toda la gente honesta del programa nuclear argentino: si alguien quiere fierros nucleares argentinos, que los pague.

Y si quiere «know how», es decir la miríada de pequeños secretos comerciales de ingeniería y de ciencia de materiales necesarios para hacer un buen combustible, o incluso los rectores y centrales que funcionan gracias a ese combustible, poniéndose estaba la gansa. Los demás, fuera de la cocina.

Y los que han querido nuestros fierros y recetas de cocina son unos cuantos: Perú, Argelia, Egipto, Holanda, Arabia Saudita, y siguen las firmas. Licitación donde se presenta INVAP, firma de la Comisión Nacional de Energía Atómica, EEUU directamente desiste de competir. ¿Por qué? Porque su tecnología es vieja y cara.

El TNP ya nos había puesto cámaras y sensores en TODAS las instalaciones y laboratorios nucleares. Y el OIEA no le guarda secretos comerciales a los EEUU. Como que fue fundado por EEUU en 1957 para exportar SU tecnología. No les ha ido muy bien.

Últimas dos palabras sobre el TNP. Esta nueva humillación perfecciona un documento que nació asimétrico. Le da a las cinco potencias del Consejo de Seguridad de la ONU luz verde para meter sus proctológicas narices en todo nuestro programa. Pero en contrapartida, la Argentina (y todos los firmantes) no tienen acceso alguno a los programas nucleares de EEUU, Francia, el Reino Unido, Rusia y China.

El problema no es tanto que no tengamos acceso a la cocina de estos buenos muchachos: tenemos la nuestra. El problema es que el TNP obliga a las 5 potencias con armas nucleares legales según este documento a limitar sus arsenales. Cosa que se cumplió brevemente en este siglo, pero hoy vuelve a reinar con alegría la proliferación.

El TNP es el desarme de los desarmados. Así lo bautizó el diplomático argentino José María Ruda en 1968, y la frase pegó en casi todo el Tercer Mundo.

Será por eso que el TNP no sirve de mucho, incluso fuera del ámbito de las superpotencias. Es de cumplimiento opcional. Israel, la India, Pakistán, Sudáfrica y Corea del Norte desarrollaron sus arsenales nucleares ignorando olímpicamente el TNP. Israel y la Sudáfrica racista del «appartheid», desarrollaron su arsenal nuclear con colaboración no muy disimulada de los EEUU y de Francia, según el caso. Es un documento para el cual hay hijos y entenados.

A los entenados no les va tan bien. Haber firmado el TNP no salvó a Irak de ser invadido y despedazado por EEUU con la excusa de que ese país estaba cocinando su bomba. Nadie extraña a Saddam Hussein, pero conservarlo o tirarlo debió ser asunto de los irakíes, que soportaron su dictadura durante décadas. Pero tenían una clase media, escuelas, colegios, universidades y hospitales públicos.

Ya no más. Ahora están ocupados por facciones en guerra de todo tipo: las bancadas por los EEUU, como los Peshmergas de Kurdistán, o los chiítas pro iraníes, y también los sunnís del ISIS, o estado islámico. Hace 23 años que Irak dejó de ser un país y se volvió un campo de batalla. Hay dos generaciones de jóvenes que no conocen la paz, el empleo o la educación.

Y ni hablar del caso de Irán. Este país había aceptado inspecciones del OIEA en 2015 a cambio de que se le devolvieran unos U$ 120 mil millones de cuentas y activos incautados por EEUU, y de que se levantaran las sanciones sobre su comercio exterior. No son gratis: le han venido costando U$ 1200 billones de los nuestros, es decir millones de millones, desde 1987.

Los argentinos también hemos sufrido de esas mismas sanciones, sin darnos por enterados. Hasta 1986, Irán fue nuestro primer comprador de trigo. Adquiría 1,2 billones de toneladas por año, lo que en dólares actualizados nos dejaba U$ 487 mil millones, el 15% del saldo exportable argentino. Luego de que se movieran secretamente algunos hilos, dejamos de venderles. Ups.

Lo que nos hace aterrizar de nuevo en asuntos nucleares. El tratado entre Irán y los EEUU era bastante claro: Irán deja de enriquecer uranio a valores mayores a 3,2, lo suficiente como para mantener su única central nucleoeléctrica, la de Bushehr, y quizás construir otro par más. A cambio, se le devolvía algo de plata y algo de comercio exterior.

No era un programa grandioso para los iraníes, pero era lo que había. La inflación generada por el desequilibrio de su balanza de pagos los estaba matando.

Poco duró esa firma. El presidente Trump rompió unilateralmente el acuerdo en 2018, y hoy está bombardeando a Irán. Ojo, lo hace pese a que la política de los persas fue dar libre acceso al inspectorado del OIEA en materia de enriquecimiento de uranio. Los iraníes no hacían esto por sumisos o por idiotas. idiotas. Necesitaban al OIEA como testigo imparcial y científico de que enriquecían uranio a los exiguos valores acordados por ese tratado, llamado con el pintoresco nombre de JCPOA, por Joint Comprehensive Plan of Action, o Plan de Acción Integral Conjunto. Pintoresco, porque da a entender que Irán tiene un problema y EEUU, Francia, Alemania e Inglaterra se juntan para resolverlo. Lo que puede la solidaridad de la OTAN…

Luego de que Trump rompiera el JCPOA y volviera a matar a los persas a sanciones, estos también necesitaron al OIEA como testigo de que ellos iban subiendo de a poco el valor de enriquecimiento, en la medida en que EEUU le iba haciendo la vida cada vez más difícil. Y en el futuro necesitarán también del OIEA, como garante de que han enriquecido unos 450 kg. al 60%, cifra bastante inútil para bombas. Aunque no está mal para motores de submarino nuclear.

Sólo que 60% es un umbral técnico y geopolítico. Llegar a 93% desde uranio natural, arrancando con el 0.87% de isótopo 235 con que sale de la mina, es un trabajo brutal en términos eléctricos, tecnológicos, materiales y de recursos humanos. Ese trabajo se mide en UTS, Unidades Técnicas de Separación.

Es un término muy de la profesión, y me lo han explicado de muy distintos modos varios expertos del OIEA sin que lo entendiera demasiado. Pero mis laboriosos entrevistados acordaron en que partiendo de 117 kg. de uranio natural a 1 kg. de enriquecido al 60% hay que gastar 152 UTS. Y ojo al piojo, con sólo 31,3 UTS adicionales se llega a una masa ínfima de enriquecido al 93%, o grado bomba.

Es sólo un 17% del trabajo total partiendo desde el uranio natural. Las instalaciones y los expertos los iraníes ya las tienen, y bien dispersas, bajo casi 100 metros de roca dura, a cubierto de misilazos. Su mensaje a Washington y a Tel Aviv, pese a que ambos están deshaciendóles el país, sigue siendo: «Si nos joden más, damos el paso que nos falta». Y entonces, agarrate Catalina.

Nadie que haya vivido algunos años en democracia puede enamorarse de los ayatollahs. Se podrá pensar pestes de cualquier teocracia, pero la iraní está demostrando una paciencia temible, mientras sus enemigos no dejan crimen contra la humanidad sin cometer y ley internacional sin quebrar. Y sin éxito, para su mal.

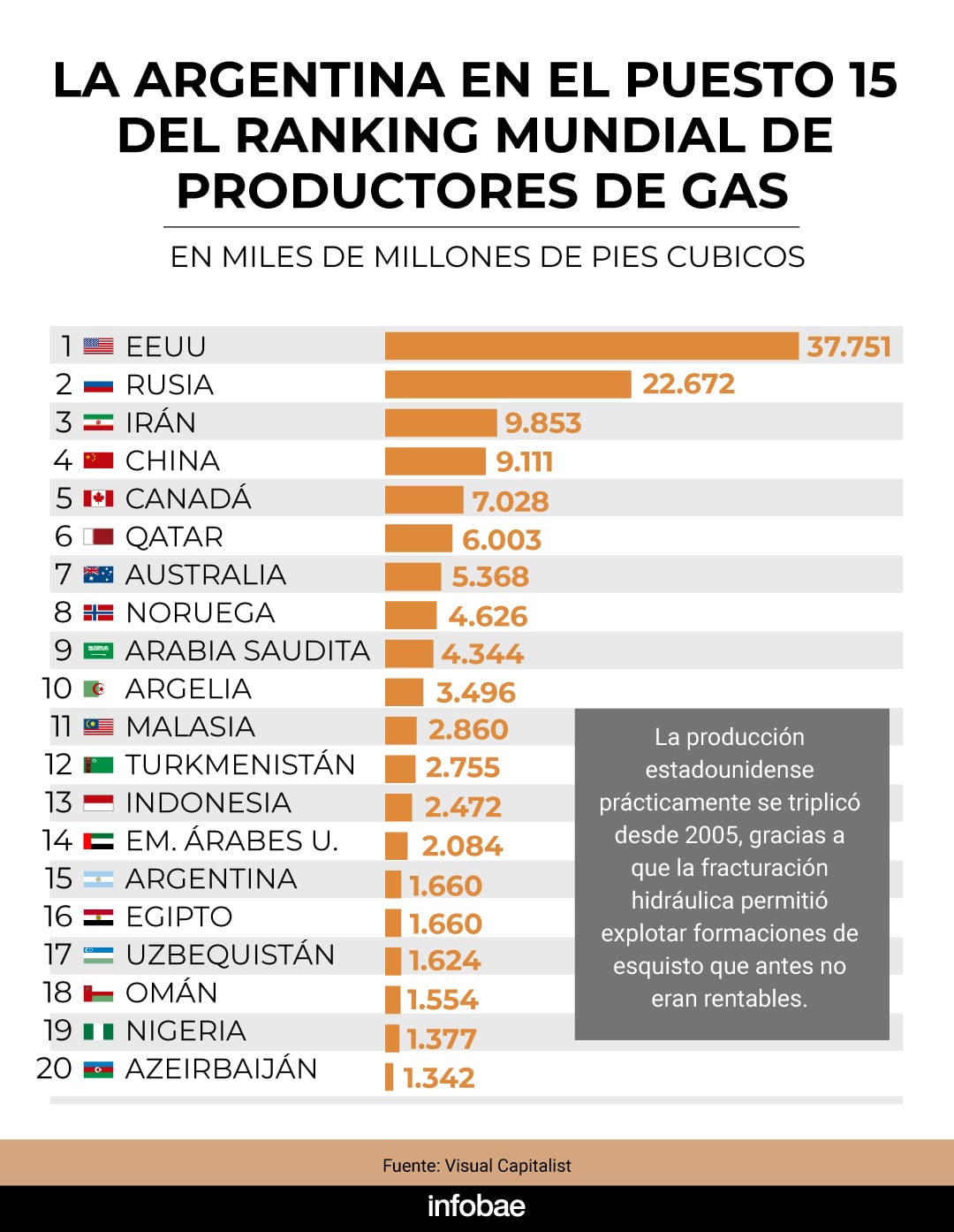

Ahora está bastante claro que si uno tiene petróleo y tecnología nuclear pacífica, puede ser visitado, amable o violentamente, por los EEUU, que están muy interesados en dominar el comercio mundial de petróleo, pese a ser el primer productor.

Dicho en favor del OIEA, su director en 2003, el egipcio Muhammad El Baradei, a la sazón director general de ese organismo multilateral, inspeccionó científicamente a Irak hasta darlo vuelta, a pedido del presidente George W. Bush. Y El Baradei anunció públicamente que los persas no tenían indicios físicos, químicos o ingenieriles de tener un programa nuclear militar en todo su país.

El presidente George W. Bush entonces invadió el susodicho país, de todos modos, destruyó todo su estado, industrias, escuelas, hospitales e instituciones de gobierno incluidas, y cuando hubo hecho daños irremediables se retiró, tras dejar en Irak una guerra civil que todavía sigue. Ah, y además un acceso gratis de EEUU al petróleo iraquí. Eso para resarcirse un poco de su ayuda humanitaria.

Vuelvo al tema de las declaraciones de la Dra. Serquis: ya tenemos cámaras, y sensores químicos y radiológicos mucho más sensibles y batidores que las cámaras. Han sido plantados antes en algunas, y desde 1995 en todas las instalaciones nucleares argentinas. Reportan al OIEA, que después del raje/renuncia ElBaradei, acata lo que diga el State Department sin chistar.

¿Más cámaras y más narices electrónicas yanquis, además de narices humanas nacidas en Idaho o en Colorado? La situación tecnológica no cambia gran cosa. En las centrales y reactores ya había. Ahora la diferencia será que nuestros físicos e ingenieros nucleares podrán ser seguidos visualmente y en tiempo real hasta en los pasillos, no sólo en sus talleres y laboratorios. Tampoco esto es tan nuevo.

Pero la situación diplomática sí cambia con esta novedad: agrava hasta lo grotesco la humillación pública internacional, subraya a brocha gorda la sumisión colonial de la Argentina de hoy. Miren cómo le hacemos lo que se nos canta a estos insumisos, se dice urbi et orbni. Y los insumisos todavía piden más látigo.

Nuestro programa nuclear, otrora sofisticado y competitivo, este gobierno lo quiere reducir a la exportación de uranio argentino hacia los EEUU. Fuera científicos, minero, a tu mina. ¿Cuándo nos volvimos un país tan de brutos, colaboracionistas y buchones, tan bananero por elección propia, pero sin bananas?

Nuestra interminable vocación de colonia, ésa la tenemos adentro.

Algo así habría dicho el Diego.

Daniel E. Arias